Decisão Judicial Suspende Sanção do Pentágono Contra Anthropic: O Impasse Global entre IA Ética e Defesa

O embate entre a gigante de inteligência artificial Anthropic e o Departamento de Defesa dos EUA revela as complexas tensões sobre o uso ético da IA em cenários militares e seus reflexos no futuro da tecnologia global.

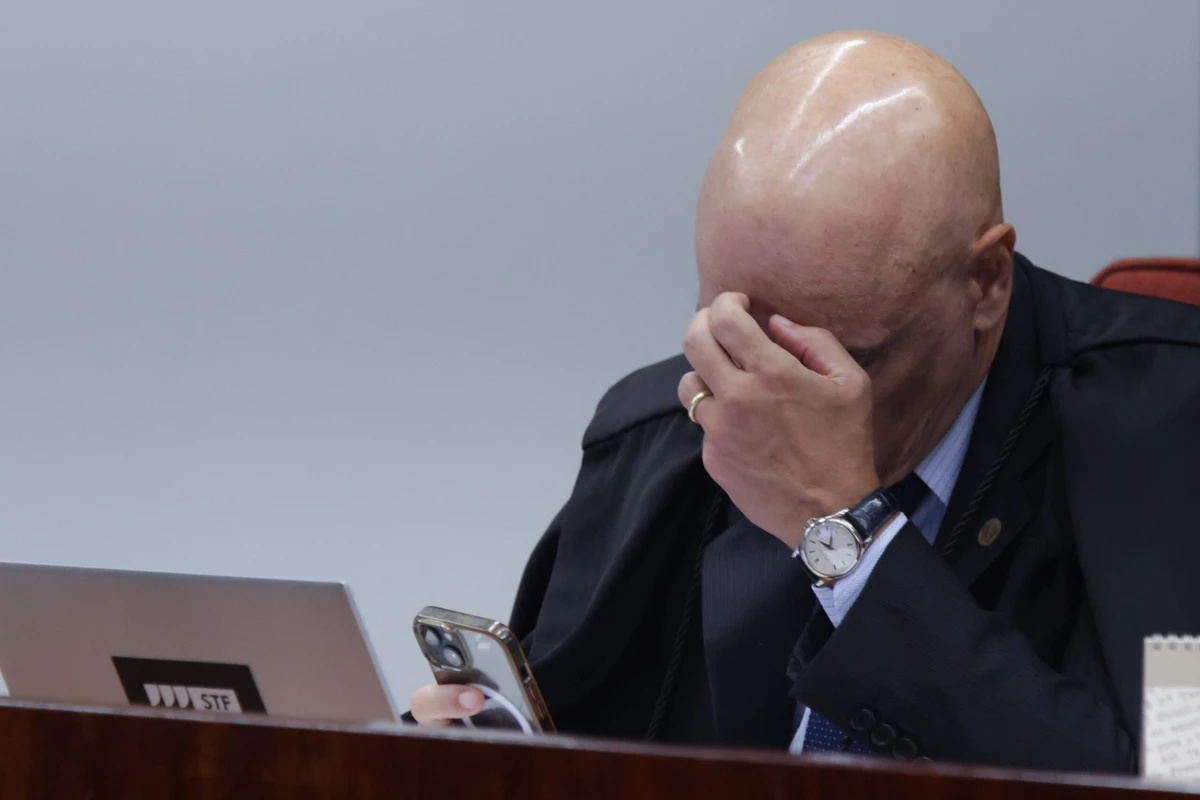

Reprodução

Reprodução

A recente decisão de um tribunal norte-americano, que suspendeu temporariamente as sanções impostas pelo Pentágono à Anthropic, uma das principais desenvolvedoras de inteligência artificial, expõe uma intrincada teia de desafios éticos, econômicos e de segurança que definem a nova era da tecnologia global. Esta medida judicial não é apenas um alívio para a Anthropic, mas um marco que sinaliza o crescente atrito entre o imperativo da segurança nacional e a busca por um desenvolvimento de IA responsável.

O cerne da disputa reside na recusa da Anthropic em permitir que seu modelo de IA, Claude, fosse utilizado em cenários de vigilância em massa de cidadãos norte-americanos ou em armamentos autônomos. A empresa defendeu restrições de segurança inegociáveis, argumentando que a ética e a segurança devem preceder o potencial militar irrestrito. Tal postura provocou uma reação forte da administração, que classificou a Anthropic como um "risco à cadeia de suprimentos da segurança nacional", efetivamente bloqueando contratos federais e gerando severas críticas por parte de figuras como o Secretário de Defesa.

A juíza Rita Lin, ao emitir a liminar, não só questionou a legalidade e a arbitrariedade da designação do Pentágono, mas também levantou a importante questão da liberdade de expressão, sugerindo que a sanção poderia ser uma retaliação à crítica pública da empresa. Este ângulo adiciona uma camada de complexidade democrática à discussão, transformando o caso em um debate sobre os limites do poder governamental sobre o setor privado em tempos de avanços tecnológicos exponenciais e sobre os direitos constitucionais envolvidos.

Para além do litígio imediato, este episódio ressoa profundamente no cenário global. Ele força uma reflexão sobre quem define os limites do uso da IA, especialmente em contextos militares. Se empresas de tecnologia têm o poder e a responsabilidade de impor restrições éticas ao uso de suas criações, qual o papel dos governos? A escolha da Anthropic em priorizar a ética sobre lucros imediatos, em um setor onde a concorrência por contratos governamentais é feroz (vide o acordo posterior da OpenAI com o Pentágono), estabelece um precedente significativo. Este embate não se restringe às fronteiras americanas, mas lança luz sobre a urgência de regulamentações internacionais e acordos globais para o desenvolvimento e uso da IA, afetando a segurança, a privacidade e a própria definição de conflito na era digital.

Por que isso importa?

Contexto Rápido

- O avanço vertiginoso da inteligência artificial nas últimas décadas trouxe à tona debates cruciais sobre seu uso ético, especialmente em aplicações militares, culminando em discussões globais sobre a proibição de armas autônomas letais.

- Estimativas de mercado apontam para um investimento crescente em IA para defesa, projetado para atingir dezenas de bilhões de dólares nos próximos anos, intensificando a corrida tecnológica entre as grandes potências mundiais.

- Este caso simboliza o dilema global entre a inovação tecnológica liderada por empresas privadas e as exigências de segurança nacional, pondo em xeque a autonomia corporativa frente aos interesses estratégicos dos estados e a necessidade premente de governança internacional para tecnologias disruptivas.