Reguladores da UE Acusam Meta de Falhas Críticas na Proteção de Crianças Online

A Comissão Europeia levanta sérias questões sobre a eficácia dos mecanismos de segurança do Facebook e Instagram para menores de 13 anos, com implicações financeiras e sociais profundas.

Reprodução

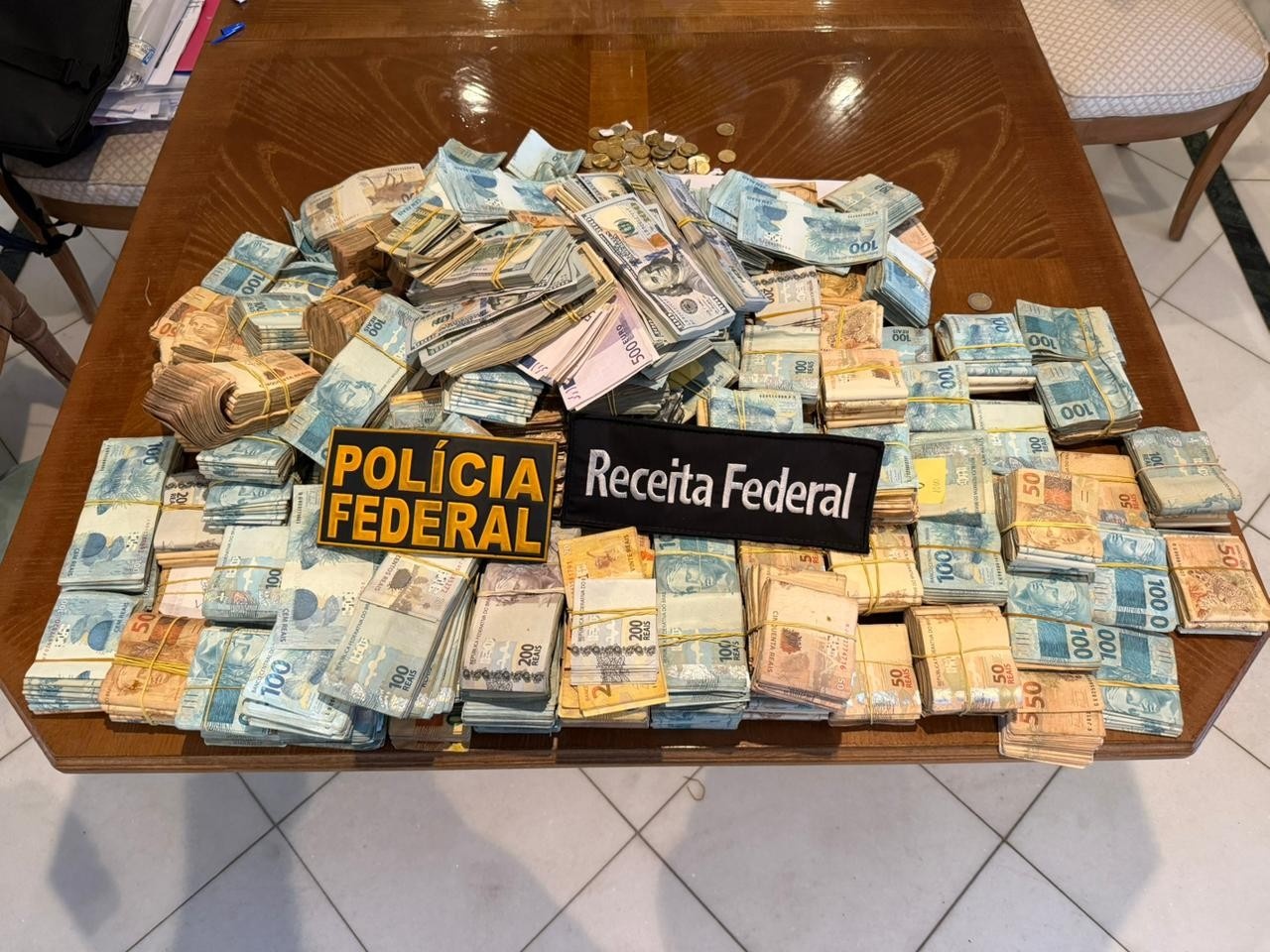

Reprodução

A Comissão Europeia intensifica sua ofensiva contra as gigantes da tecnologia, formalizando acusações preliminares contra a Meta, controladora do Facebook e Instagram, por falhas sistêmicas na proteção de crianças menores de 13 anos. Este movimento não é apenas um alerta, mas um divisor de águas na governança digital, sinalizando que a era da autorregulação indulgente está se esgotando.

As conclusões, resultantes de uma investigação minuciosa de dois anos sob a égide da Lei de Serviços Digitais (DSA), apontam para a ineficácia dos mecanismos da Meta em prevenir o acesso de menores e em identificar e remover contas criadas por eles. A seriedade da situação é sublinhada pela potencial multa de até 6% do faturamento anual global da empresa, uma quantia que poderia redefinir estratégias de produto e compliance em escala industrial. A Meta, por sua vez, contesta as conclusões, prometendo novas medidas, mas o veredicto europeu ressoa globalmente.

Este cenário não se limita a uma disputa regulatória; ele reflete uma preocupação crescente e transversal sobre o impacto das redes sociais na saúde mental e no desenvolvimento de crianças e adolescentes. A ação da UE serve como um catalisador para uma reavaliação fundamental das responsabilidades das plataformas digitais e do futuro da segurança online para as gerações mais jovens.

Por que isso importa?

Contexto Rápido

- A implementação da Lei de Serviços Digitais (DSA) da União Europeia, um marco regulatório que visa impor maior responsabilidade às grandes plataformas digitais, sucedendo a Lei de Mercados Digitais (DMA) e solidificando a vanguarda europeia em governança tecnológica.

- Estimativas recentes indicam que entre 10% e 12% das crianças europeias com menos de 13 anos utilizam as plataformas da Meta, um dado alarmante que corrobora a pressão global por mecanismos mais robustos de verificação de idade e moderação de conteúdo, ecoando as crescentes preocupações de pais, educadores e autoridades de saúde sobre o bem-estar digital de jovens.

- A discussão sobre o "design ético" de produtos tecnológicos e a responsabilidade algorítmica ganha tração, forçando empresas como a Meta a reavaliar a prioridade da segurança do usuário, especialmente a de crianças, em detrimento do engajamento irrestrito, delineando uma nova fronteira para a inovação e o compliance na categoria de Tecnologia.