A Inteligência Artificial Redesenha o Campo de Batalha: Ética, Proliferação e o Futuro da Ciência no Conflito

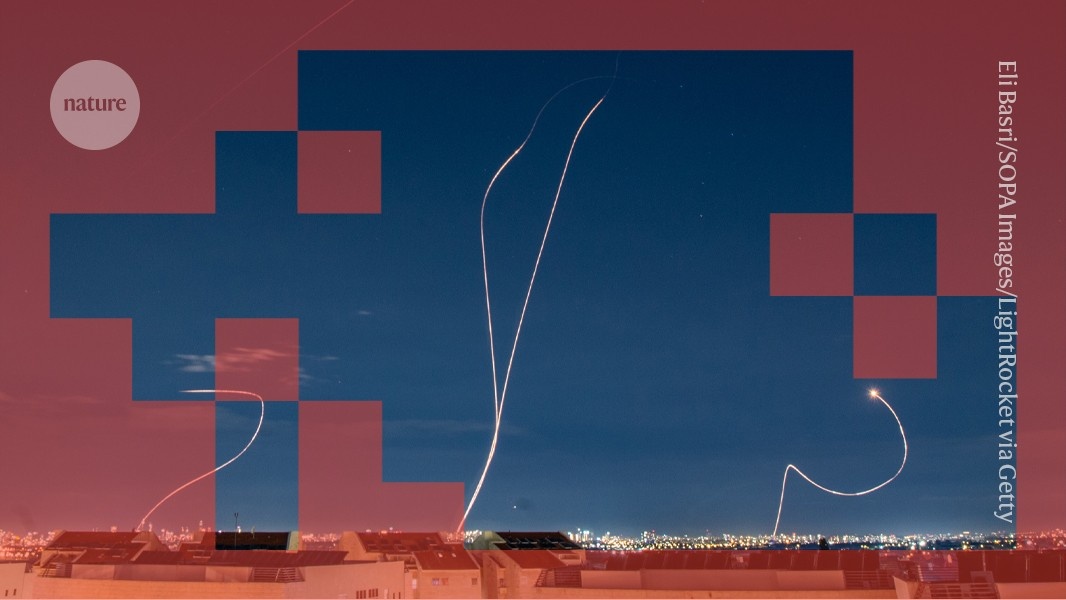

Enquanto mísseis são guiados por algoritmos no Oriente Médio, a comunidade global enfrenta a corrida entre o avanço tecnológico militar e a urgência de um arcabouço ético e legal para a autonomia letal.

Reprodução

Reprodução

A escalada de tensões geopolíticas, notadamente nos recentes embates entre Estados Unidos, Israel e Irã, juntamente com os conflitos em curso na Ucrânia e em Gaza, lança um holofote implacável sobre a crescente integração da Inteligência Artificial (IA) na guerra moderna. O que antes era matéria de ficção científica, hoje é uma realidade palpável: algoritmos complexos não apenas processam vastas quantidades de dados logísticos e de inteligência, mas também assistem na identificação e priorização de alvos, acelerando drasticamente as capacidades de ataque. Essa convergência de tecnologia de ponta e conflito armado representa um novo e perigoso capítulo na história militar, cujas ramificações éticas e sociais são apenas agora sendo compreendidas.

O uso da IA em sistemas como o Maven Smart System, que emprega processamento de imagens e suporte tático, sublinha a mudança de paradigma. Contudo, essa evolução tecnológica ultrarrápida contrasta dramaticamente com o ritmo glacial das discussões internacionais sobre regulação. A controvérsia recente entre o Departamento de Defesa dos EUA e a Anthropic, uma das principais empresas de IA, ilustra a seriedade do impasse. A empresa recusou-se a remover salvaguardas que impediam o uso de seu modelo Claude para vigilância em massa ou para guiar armas totalmente autônomas, levantando a questão fundamental: quem define os limites morais da tecnologia que criamos e empregamos em um cenário de guerra? Este não é um debate meramente técnico; é um imperativo ético que permeia o cerne da pesquisa e desenvolvimento científico.

Por que isso importa?

Para o leitor atento à Ciência, as implicações desta nova era são profundas e multifacetadas. Primeiro, ela força uma reavaliação do papel do cientista e do desenvolvedor de tecnologia na sociedade. A recusa da Anthropic em ceder às exigências do Pentágono, mesmo perdendo um contrato multimilionário, estabelece um precedente crucial sobre a responsabilidade ética corporativa e a capacidade da indústria em resistir a usos que considerem imorais ou perigosos. Isso levanta questões sobre se outras empresas seguirão este caminho ou se a busca por lucratividade prevalecerá sobre a consciência ética, moldando o futuro das grandes corporações de tecnologia e seus compromissos sociais.

Em segundo lugar, a ausência de um arcabouço legal global para armas autônomas gera uma "zona cinzenta" onde a proliferação desregulada de IA militar pode se tornar a norma. O argumento de que a precisão da IA poderia reduzir baixas civis é posto em xeque por conflitos como os da Ucrânia e Gaza, onde a alta contagem de mortos civis persiste apesar do uso de IA para identificação de alvos. Isso sugere que a mera eficiência tecnológica não se traduz automaticamente em resultados humanitários superiores e, de fato, pode mascarar a desumanização do processo decisório. A ciência, aqui, não oferece respostas automáticas, mas sim ferramentas que exigem uma profunda reflexão humana sobre suas consequências.

Finalmente, a discussão sobre o controle humano versus a autonomia completa da IA no campo de batalha é vital. Os modelos de linguagem grandes (LLMs) atuais, embora poderosos, não são confiáveis para operar armas letais sem supervisão humana e, crucialmente, não cumprem as leis humanitárias internacionais, que exigem distinção entre combatentes e civis. A comunidade científica, portanto, é desafiada a desenvolver não apenas tecnologias mais avançadas, mas também métodos robustos para garantir a supervisão humana e a aderência a princípios éticos. O futuro da segurança global e a própria reputação da inovação científica dependem de como essa linha tênue será navegada nos próximos anos, transformando este debate de uma questão militar para uma questão central da bioética e da ética em inteligência artificial.

Contexto Rápido

- A ofensiva EUA-Israel no Oriente Médio e a consequente disputa entre o governo dos EUA e a Anthropic sobre as cláusulas de uso da IA.

- Encontros contínuos de acadêmicos e especialistas jurídicos em Genebra para discutir sistemas de armas autônomas letais e a aquisição de IA militar, buscando um acordo internacional sobre o uso ético.

- A velocidade do desenvolvimento tecnológico da IA supera a capacidade das discussões internacionais em estabelecer regulamentações eficazes, sugerindo uma proliferação iminente da guerra por IA sem diretrizes claras.