A Ascensão dos Golpes de Clonagem de Voz por IA e Seus Riscos Reais para o Cidadão Comum

O caso da atriz Drica Moraes expõe a nova fronteira dos golpes digitais, onde a inteligência artificial aprofunda vulnerabilidades e exige vigilância redobrada dos usuários.

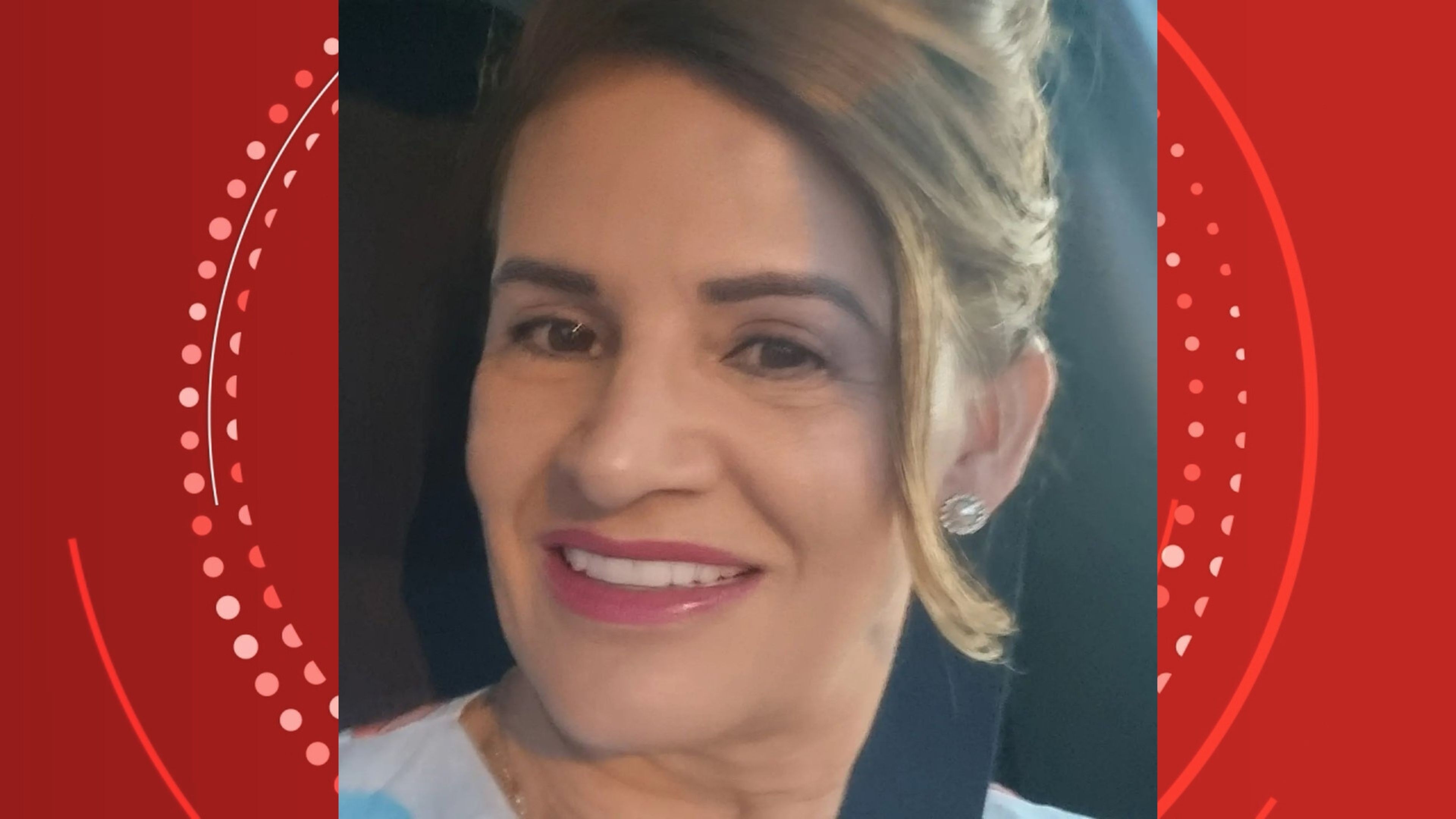

Reprodução

Reprodução

A recente denúncia da atriz Drica Moraes sobre ser alvo de criminosos que utilizaram inteligência artificial para clonar sua voz e aplicar golpes financeiros em seu círculo pessoal não é apenas uma notícia isolada; é um alerta contundente para a sofisticação crescente das fraudes digitais. O incidente, que envolveu a clonagem de seu celular e o uso de áudios falsificados para se passar por ela, ilustra uma evolução perigosa nos métodos de engenharia social.

Longe das táticas rudimentares de mensagens de texto mal redigidas, a era da IA generativa está pavimentando o caminho para um tipo de engano que explora a confiança e a familiaridade. A capacidade de replicar fielmente a voz de uma pessoa confere aos criminosos uma ferramenta poderosa para ultrapassar barreiras de segurança psicológicas, tornando extremamente difícil para vítimas em potencial discernir a autenticidade das solicitações, especialmente quando a pressão por uma ação rápida é aplicada.

Por que isso importa?

Contexto Rápido

- A clonagem de voz por inteligência artificial, antes restrita a laboratórios avançados, tornou-se acessível a criminosos por meio de ferramentas de IA generativa de baixo custo ou até gratuitas, baixando significativamente a barreira de entrada para fraudes sofisticadas.

- Estudos recentes indicam um aumento global de 30% nos ataques de engenharia social envolvendo deepfakes de áudio nos últimos dois anos, com perdas financeiras estimadas em bilhões, conforme dados da Cybersecurity Ventures.

- O incidente com Drica Moraes insere-se em um contexto maior de vulnerabilidade digital da população geral, onde a familiaridade com a voz de um ente querido ou colega pode ser explorada para extrair dados sensíveis ou quantias financeiras, sem a necessidade de roubo físico ou acesso a credenciais diretas.