Fundamentação Frágil: Modelos de IA Médica Treinados em Dados de Origem Inconsistente

Estudo recente revela que algoritmos promissores para diagnóstico de AVC e diabetes foram alimentados com informações potencialmente fabricadas, levantando sérias preocupações sobre a segurança e eficácia clínica.

Reprodução

Reprodução

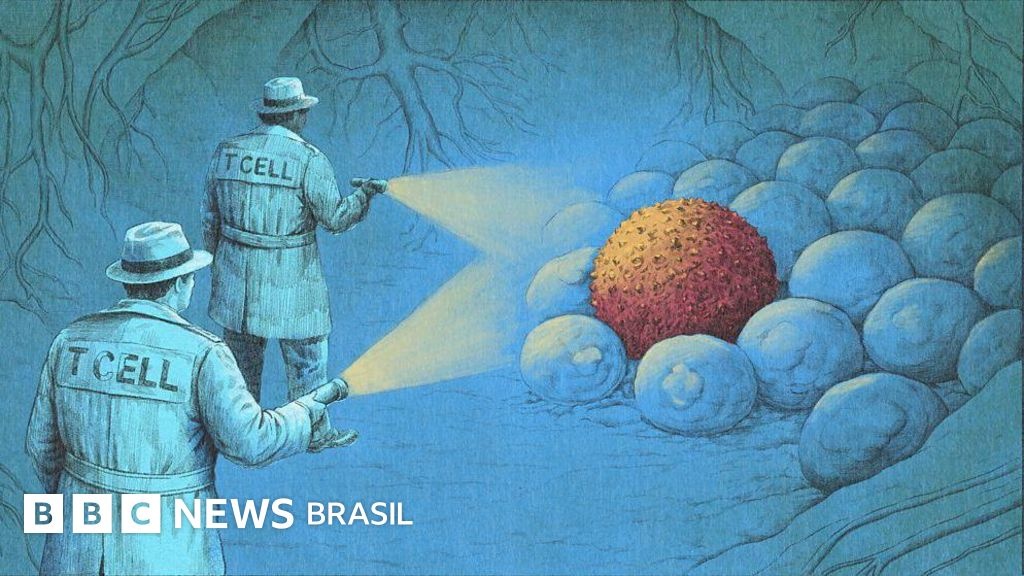

A promessa da inteligência artificial em revolucionar a medicina, otimizando diagnósticos e tratamentos, enfrenta um revés significativo. Uma pesquisa pré-publicada no medRxiv, destacada pela revista Nature, expôs que dezenas de modelos de IA destinados à previsão de doenças como Acidente Vascular Cerebral (AVC) e diabetes foram treinados utilizando conjuntos de dados abertos que, em análise aprofundada, mostram indícios de serem artificialmente gerados ou de procedência altamente duvidosa.

Especialistas como Adrian Barnett, estatístico da Queensland University of Technology, expressaram surpresa diante das anomalias encontradas. Ao examinar dois repositórios de dados abertos hospedados na plataforma Kaggle – um para AVC e outro para diabetes – a equipe de Barnett identificou padrões estatísticos implausíveis para dados coletados de seres humanos reais. Dentre as irregularidades, destacam-se a ausência quase completa de lacunas nos registros, uma característica irrealista para dados clínicos, e a repetição excessiva de valores para métricas como o nível de glicose no sangue, com apenas 18 valores discretos para 100 mil indivíduos no conjunto de dados de diabetes.

O mais alarmante é que alguns desses modelos, desenvolvidos a partir de informações de procedência incerta, já foram reportados em uso clínico em hospitais na Indonésia e na Espanha. Além disso, um deles consta em um pedido de patente de dispositivo médico de 2024 e dois estão disponíveis como ferramentas web públicas, permitindo que usuários verifiquem seu próprio risco de saúde. Soumyadeep Bhaumik, pesquisador de saúde pública do George Institute for Global Health, é enfático: “Modelos preditivos treinados em dados de proveniência desconhecida não têm lugar na tomada de decisões clínicas. Eles são intrinsecamente não confiáveis”. O risco é palpável: diagnósticos equivocados que podem levar a tratamentos desnecessários ou, o que é ainda mais grave, à ausência de intervenções cruciais.

Por que isso importa?

Contexto Rápido

- O entusiasmo global e o robusto investimento em inteligência artificial na área da saúde para aprimorar a precisão diagnóstica e a eficiência terapêutica marcam uma era de grande expectativa tecnológica.

- A proliferação de plataformas de dados abertos, como Kaggle, democratiza o acesso a informações para o desenvolvimento de modelos de machine learning, mas impõe um desafio crescente na validação da origem e qualidade desses dados.

- No campo da Ciência e da Medicina, a integridade da pesquisa e o rigor metodológico são inegociáveis, estendendo-se à coleta, curadoria e validação de cada conjunto de dados que serve de base para ferramentas com impacto direto na vida humana.