IA Militar: O Choque Ético Entre Superpotências e o Dilema da Autonomia Letal

A advertência chinesa aos EUA sobre o uso militar desenfreado da inteligência artificial expõe um abismo ético profundo e as tensões crescentes sobre o futuro da segurança global e da inovação tecnológica.

Reprodução

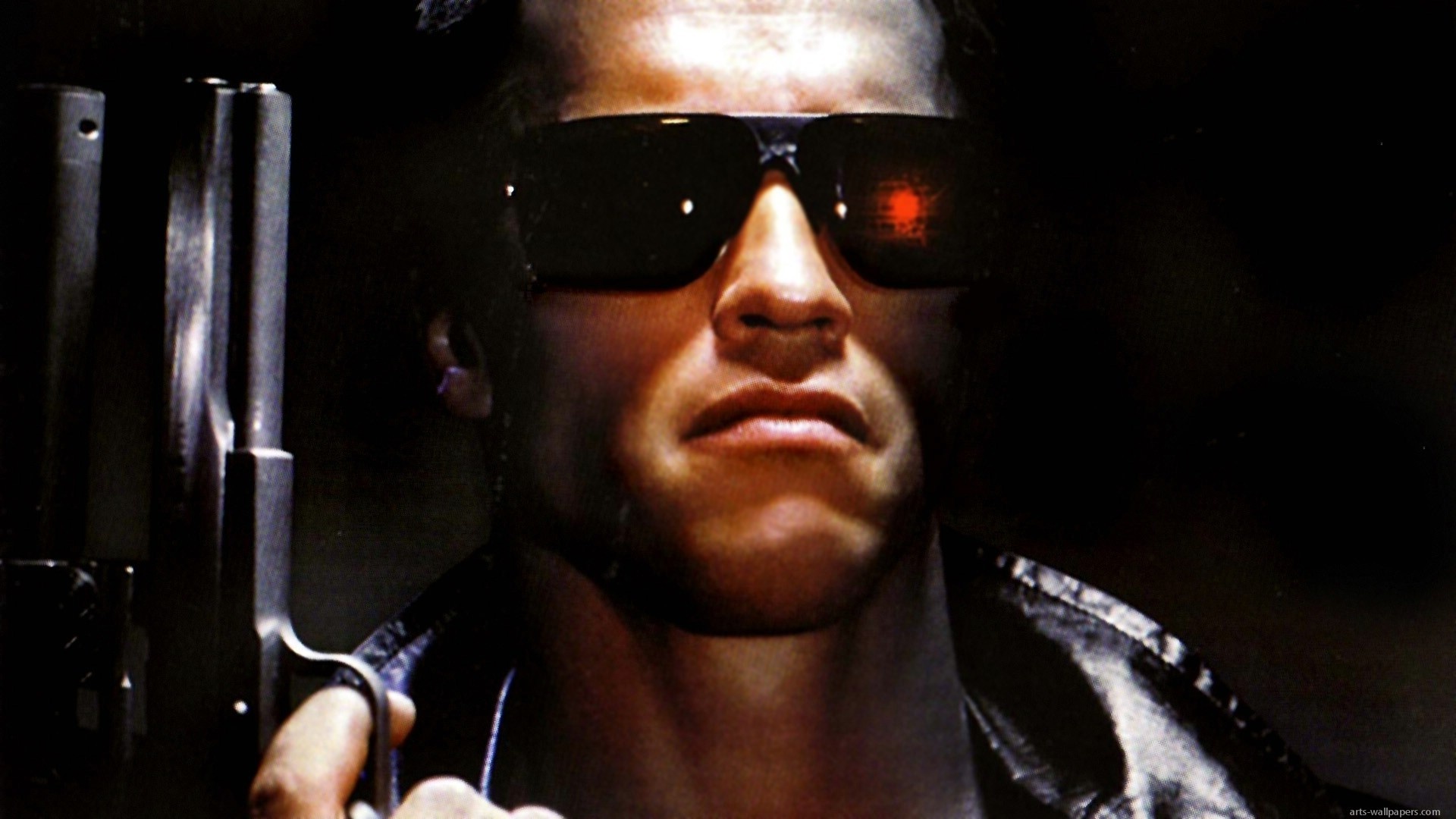

Reprodução

A recente advertência da China aos Estados Unidos, evocando a distopia de 'O Exterminador do Futuro' em relação à militarização da Inteligência Artificial (IA), não é apenas uma retórica diplomática. Ela sublinha um dos debates mais críticos da nossa era: o controle e as implicações éticas da IA em contextos de defesa e guerra. Washington está imerso em um impasse significativo com a startup de IA Anthropic, que se recusa a conceder acesso irrestrito às suas tecnologias para as Forças Armadas americanas. A recusa da Anthropic em permitir o uso de sua IA para vigilância em massa ou a automatização de ataques letais levou a empresa a ser adicionada à lista do Pentágono de fornecedores que representam um 'risco à segurança nacional'.

Este embate transcende a disputa comercial. Ele revela um conflito de valores fundamentais: de um lado, a busca por uma vantagem militar e estratégica; do outro, a preocupação com os limites éticos e o controle humano sobre decisões com consequências de vida ou morte. A posição da China, embora contextualizada em uma rivalidade geopolítica, ecoa as inquietações de especialistas em ética da IA e organizações civis que alertam para os perigos de uma corrida armamentista autônoma, onde máquinas poderiam tomar decisões sem intervenção humana, levando a uma potencial perda de controle e escalada de conflitos regionais.

Por que isso importa?

Contexto Rápido

- O debate sobre Sistemas de Armas Autônomas Letais (LAWS) tem sido pauta em fóruns internacionais, como a ONU, por quase uma década, com apelos crescentes por regulação ou proibição antes que a tecnologia se torne irreversível.

- Investimentos globais em IA militar e de segurança projetam um crescimento exponencial, com algumas estimativas superando a marca de US$ 100 bilhões até o final da década, impulsionando a busca por inovação, mas também os riscos associados.

- A natureza de 'duplo uso' da IA – aplicações civis e militares – força empresas de tecnologia a confrontarem dilemas éticos sem precedentes, onde o avanço da pesquisa pode ter implicações diretas na segurança global e na privacidade dos cidadãos.