O Dilema Ético da IA Militar: Entre a Autonomia e a Responsabilidade Humana

A crescente integração da inteligência artificial em operações de defesa e a busca por sistemas éticos levantam questões profundas sobre segurança, privacidade e o futuro da governança tecnológica.

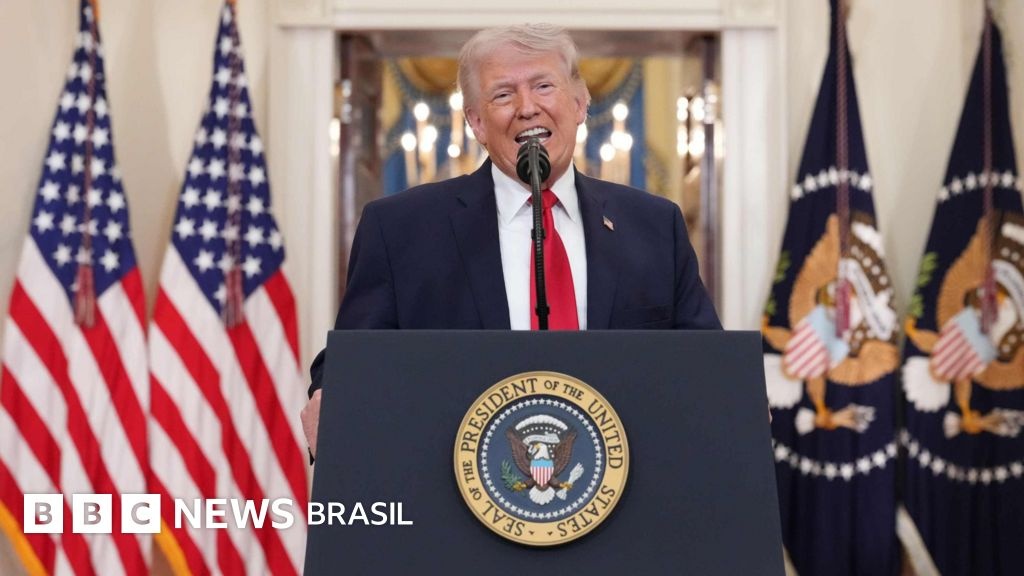

Reprodução

Reprodução

Avanços em inteligência artificial (IA) prometem transformar diversas esferas da sociedade, mas é na intersecção com as operações militares que o debate ético atinge seu ponto mais crítico. Enquanto gigantes da tecnologia como a OpenAI enfrentam campanhas de boicote e críticas sobre a transparência e uso de seus modelos, a discussão se estende ao desenvolvimento de sistemas autônomos para fins bélicos. O questionamento central é se a IA pode realmente operar de maneira ética em contextos de guerra e, mais amplamente, como a sociedade pode garantir a responsabilidade em um campo dominado por poucas, mas poderosas, corporações.

Especialistas e críticos de tecnologia, como Aya Jaff, e fundadores de iniciativas alternativas, como Said e Hani Chihabi da Thaura.AI, apontam para a necessidade urgente de desenvolver IA que não apenas seja tecnicamente avançada, mas intrinsecamente ética e accountable. A busca por “alternativas éticas” não é apenas uma questão de mercado, mas uma corrida contra o tempo para definir os limites de uma tecnologia que tem o potencial de redefinir o conceito de conflito e, por extensão, a segurança global.

Por que isso importa?

Primeiramente, a **segurança global** está em jogo. A proliferação de armas autônomas, capazes de tomar decisões de vida ou morte sem intervenção humana, pode levar a uma escalada de conflitos imprevisível. Erros algorítmicos ou vieses de programação poderiam ter consequências catastróficas, resultando em mortes civis desnecessárias ou na deflagração de guerras que escapam ao controle humano. Isso impacta a estabilidade geopolítica e, por extensão, a sensação de segurança de indivíduos em qualquer parte do mundo.

Em segundo lugar, a **privacidade e a liberdade individual** são ameaçadas. Se as mesmas corporações que desenvolvem IA para consumo civil também são as que fornecem tecnologias para fins militares e de vigilância, existe um risco intrínseco de que dados pessoais sejam utilizados de formas não consentidas, ou que sistemas de vigilância se tornem onipresentes, erodindo a privacidade e a capacidade de dissidência. A falta de transparência e de responsabilidade (accountability) dessas grandes empresas pode solidificar um futuro onde a tecnologia, em vez de empoderar, controla. A emergência de iniciativas como a Thaura.AI oferece uma luz de esperança, buscando modelos de IA que priorizem o bem-estar social e a ética desde a concepção, o que poderia democratizar o acesso e o controle sobre essas tecnologias, garantindo que o seu desenvolvimento sirva à humanidade, e não apenas a interesses específicos.

Contexto Rápido

- A corrida armamentista tecnológica das últimas décadas tem visto a crescente incorporação de drones, reconhecimento facial e sistemas de vigilância, pavimentando o caminho para armas totalmente autônomas.

- O mercado global de IA deve crescer exponencialmente, atingindo trilhões de dólares nos próximos anos, com um percentual significativo dedicado a aplicações de defesa e segurança, levantando preocupações sobre o controle e a ética desses desenvolvimentos.

- A polarização entre o avanço tecnológico rápido e a lentidão na criação de marcos regulatórios globais cria um vácuo que pode ser preenchido por interesses corporativos e estatais sem a devida supervisão pública ou ética.