A Revolução Silenciosa na Interação com IAs: Desvendando a Verdadeira Engenharia de Prompts

Novas pesquisas desmistificam a 'magia' dos prompts e revelam o caminho para extrair a máxima eficiência de modelos de linguagem como ChatGPT e Gemini, transformando a forma como interagimos com a tecnologia.

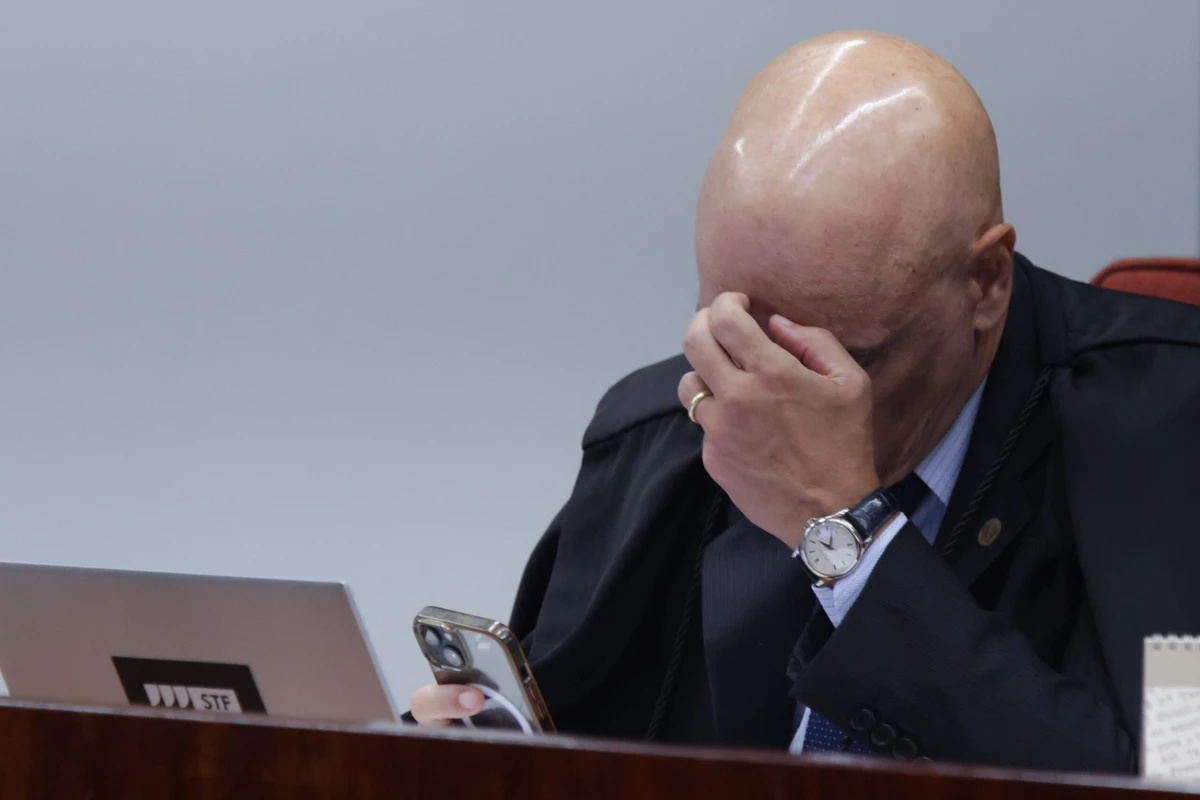

Reprodução

Reprodução

A ascensão vertiginosa da Inteligência Artificial Generativa redefiniu nossa interação com a tecnologia, mas trouxe consigo uma miríade de mitos sobre como "falar" com essas máquinas. Usuários, de entusiastas a profissionais, têm explorado abordagens intuitivas – bajular, ameaçar, ser educado ou até mesmo pedir para a IA "fingir" ser um especialista – na tentativa de obter respostas superiores. No entanto, uma análise aprofundada por pesquisadores e engenheiros de ponta está desmantelando essas noções, revelando que a chave para a eficiência reside não na personificação, mas na compreensão fundamental da IA como uma ferramenta sofisticada.

O "porquê" dessa desmistificação é crucial. Grandes Modelos de Linguagem (LLMs) operam com base em bilhões de parâmetros estatísticos, processando "tokens" (pequenos blocos de texto) para prever a próxima sequência mais provável de palavras. Eles não possuem emoções, senso de humor ou a capacidade de serem "influenciados" por bajulações ou ameaças. A aparente receptividade a essas abordagens é, na verdade, uma simulação de comportamento humano, fruto do treinamento exaustivo em vastos volumes de texto. Tratar um LLM como um ser humano não apenas é ineficaz para a precisão, mas pode ser perigoso, incentivando a "alucinação" – a invenção de fatos plausíveis, mas incorretos – quando a IA é instruída a "confiar em seu conhecimento interno parametrizado" como um "especialista".

O "como" se dá essa mudança de paradigma é igualmente vital para o leitor. Em vez de focar na retórica, a eficácia está na clareza e na estrutura do pedido. Especialistas recomendam uma abordagem pragmática: pedir múltiplas opções para incentivar a reflexão e diversidade de respostas; fornecer exemplos concretos para alinhar o estilo e o tom desejados; e solicitar que a IA conduza uma "entrevista", fazendo perguntas para reunir informações antes de gerar uma resposta complexa. A encenação de papéis, embora útil para tarefas criativas ou de brainstorming, deve ser evitada quando a busca é por dados factuais e precisos. A neutralidade no prompt é imperativa para evitar "guiar" a resposta da IA. E, curiosamente, a politeness, embora sem impacto na precisão, pode melhorar o conforto do usuário, incentivando uma interação mais frequente e produtiva, um benefício psicossocial indireto.

Compreender e aplicar esses princípios significa mais do que apenas melhorar a qualidade das suas interações com IAs. Representa uma otimização substancial de tempo e recursos, tanto pessoais quanto energéticos. No cenário profissional, a capacidade de extrair informações precisas e insights relevantes de LLMs pode ser um diferencial competitivo, impulsionando a produtividade e a inovação. Para o cidadão comum, é a diferença entre uma ferramenta que frustra e uma que realmente empodera, minimizando o risco de se basear em informações geradas por um sistema que, apesar de inteligente, não é senciente. Estamos no limiar de uma nova era de interação, onde a inteligência reside em quem formula a pergunta, não em quem a responde.

Por que isso importa?

Contexto Rápido

- A popularização de interfaces de IA como ChatGPT e Gemini nos últimos dois anos gerou uma explosão de 'engenharia de prompts', inicialmente baseada em intuição e experimentação.

- Pesquisas recentes, como o estudo sobre o 'efeito Star Trek' em matemática básica, ou a observação de Sam Altman sobre os 'milhões de dólares' gastos com palavras como 'por favor', evidenciam a busca por otimização.

- A evolução acelerada dos modelos de IA, com atualizações constantes, torna muitas das estratégias de prompt de poucos anos atrás obsoletas, reforçando a necessidade de uma compreensão técnica sobre seu funcionamento.